В мире искусственного интеллекта нет однозначных лидеров. И ответ на вопрос, действительно ли Claude лучше ChatGPT, Grok или других моделей, зависит прежде всего от конкретной задачи. Именно это подчеркивают опрошенные 24 Каналом эксперты: одни модели сильнее в аналитике и работе с длинными текстами, другие – в мультимодальных сценариях, поиска актуальной информации или повседневных рабочих задачах.

В то же время дискуссия о преимуществах чат-ботов давно вышла за пределы бытового сравнения инструментов. После конфликта Anthropic с Пентагоном, который снова привлек внимание к вопросам безопасности, автономности и допустимости использования ИИ в чувствительных сферах, встал более широкий вопрос: где проходит граница между полезной помощью алгоритмов и риском делегировать им слишком много полномочий.

Эксперты, с которыми пообщался 24 Канал для этого материала, сходятся в одном: современные модели уже стали практичным инструментом для анализа, текстов, кода, логистики и обработки больших массивов данных, но они не отменяют потребности в человеческом контроле. Именно поэтому главный вопрос сегодня звучит не как "какой чат-бот лучший?", а как правильно применять ИИ в реальных условиях – от ежедневной работы до военных решений.

Действительно ли Claude лучше Grok и Chat GPT?

Волны популярности чат-ботов то поднимаются, то утихают. И в разные периоды можно услышать о преимуществах тех или иных сервисов. Несколько лет назад на пике был китайский DeepSeek, сейчас немало хороших отзывов можно услышать о Claude от Anthropic. Который, к тому же, нагнал себе популярности из-за случая с Пентагоном.

Тогда из-за отказа ослабить предохранители для использования искусственного интеллекта в автономном оружии и массовой слежке администрация Трампа и Пентагон заблокировали компанию от части государственных и оборонных контрактов, присвоив ей статус supply-chain risk. Anthropic в ответ подала иски в суд.

К теме Когда ИИ могут выключить: как Украина готовится к худшему сценарию и какая стратегия у Минцифры

Так есть ли лучший чат-бот на нынешнее время? 24 Канал опросил экспертов по искусственному интеллекту.

"Лучший" – это неоднозначная формулировка, потому что есть большое количество критериев, по которым можно сравнивать ИИ-модели и сервисы на их основе. Также отрасль чрезвычайно динамичная и высококонкурентная и лидерство на ней не является постоянным – все измениться может в одно мгновение вместе с выходом новых ИИ-моделей, разработкой которых постоянно занимаются крупные компании.

А еще важно проверять сервисы на конкретных задачах, и если для ваших задач какой-то сервис/модель подходит лучше, то она и будет лучшей для вас, даже если для кого-то выбор другой. Это сделать несложно, можно открыть одновременно несколько окон чат-ботов или запустить несколько агентов на их основе, и задать им одинаковую задачу, а потом сравнить результат.

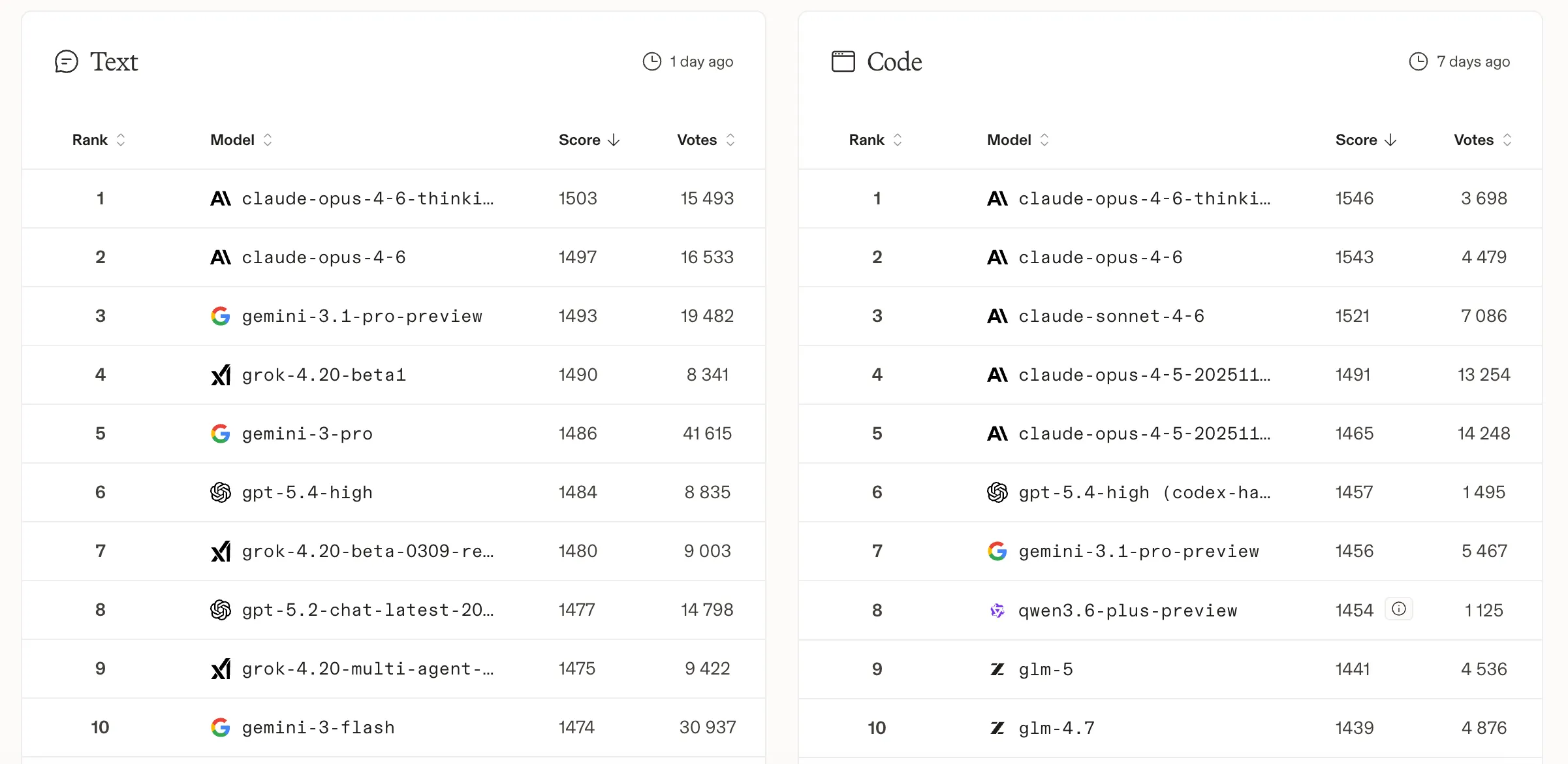

Вячеслав Колдовский также предлагает посмотреть существующие рейтинги, например, Arena AI. Claude Opus 4.6 действительно является лидером в общем рейтинге, хотя и не во всех категориях. Например, в математических задачах ее опережает GPT 5.4. Но эксперт отмечает, что модели в рейтинге стоят близко друг к другу.

Рейтинг моделей ИИ / Arena AI

О том, что все зависит от задачи, стоящей перед ИИ, отмечает и Дмитрий Софина из AI R&D Center WINSTARS.AI.

По моему опыту, нет "абсолютно лучшего" инструмента – все зависит от задачи. Claude часто сильнее в работе с длинными текстами и структурированной аналитикой, ChatGPT – наиболее универсальный и стабильный для широкого спектра задач, а Grok – быстрый и хорошо интегрирован с real-time контекстом. В практике мы комбинируем модели под конкретные кейсы. В частности решения от Google часто очень хорошо себя проявляют. Все зависит от обстоятельств.

Не стоит забывать о других важных игроках, в частности Gemini или DeepSeek, напоминает Сергей Шишкин, автор научных работ по искусственному интеллекту. Поэтому целесообразнее говорить не о "лучшей" модели, а о соответствии инструмента поставленной задаче, также отмечает эксперт.

- Одной из ключевых характеристик является размер контекстного окна – объем данных, которые модель может учитывать при формировании ответа. Это определяет ее способность работать со сложными, многофакторными материалами, говорит Шишкин.

У большинства моделей этот показатель составляет сотни тысяч токенов, тогда как Gemini декларирует значительно большие объемы. Принцип работы моделей также отличается от человеческого мышления: они обрабатывают входные данные в рамках отдельного запроса и не сохраняют непрерывный контекст вне его.

- Другой важный аспект – мультимодальность, то есть способность работать с различными типами данных. Хотя все эти системы относятся к большим языковым моделям, их работа с изображениями, видео или аудио может существенно отличаться.

Например, Gemini отличается глубокой мультимодальной интеграцией, Grok ориентирован на актуальные данные с платформы X, ChatGPT является универсальным инструментом, а Claude часто ассоциируют с высоким качеством текстовой генерации.

- Отдельно стоит учитывать роль системного промпта – внутренних инструкций, которые определяют поведение модели. Именно он задает ограничения, стиль и логику ответов, в частности по безопасности или допустимых тем. В сочетании с учебными данными это формирует конечное "поведение" модели, поэтому даже при похожей архитектуре результаты могут существенно отличаться.

Интересно! Исследование Stanford University показало, что даже специализированные AI-инструменты могут ошибаться в 17 – 33% случаев при работе с фактами. В задачах, где точность критична (а в военном контексте это почти всегда так), их нельзя использовать без проверки.

На практике это означает, что ИИ – вспомогательный инструмент, а не источник финального решения, отметила в комментарии 24 Канала Алина Пшеничникова, Head of Marketing & Product Retention Department, Netpeak.

Claude имеет преимущества в аналитике данных, подготовке текстов и особенно – в написании программного кода, считает Дмитрий Красовский, AI Integration Lead, Netpeak.

Важно отметить, что подобное утверждение актуально в конкретный период времени, поскольку каждый из фронтирных провайдеров ИИ-решений (Anthropic Claude, OpenAI ChatGPT, Google Gemini, Grok и другие) постоянно выпускает новые модели LLM, решения, и, соответственно, лидеры этой гонки могут меняться с каждым новым релизом.

Наблюдаю (с конца ноября 2025, когда вышла модель Opus 4.5, еще более заметно с модели 4.6 с начала февраля 2026), что в аналитических задачах Claude часто дает более точные результаты, требует меньше итераций улучшения за счет глубокого анализа и реже необходимости исправлений в тексте, он менее наполнен AI-паттернами.

Особенно качественные результаты можно получить с использованием Claude Cowork, нового агентного десктоп решения, которое способно работать с локальными большими файлами, и, одновременно, обеспечивать доступ к веб-ресурсам через обычный браузер. Кроме того, по умолчанию Claude может делать качественную визуализацию аналитических данных и строить дашборды, которые действительно работают и понятно доносят результат.

В работе с текстами Красовский советует по желанию настроить промт для написания текстов с соблюдением определенного стиля и минимизации ИИ-"канцеляризмов" или присущих паттернов. Это актуально как для Claude, так и для OpenAI ChatGPT.

Сэм Альтман (Open AI, второй справа), и Дарио Асмодеи (Anthropic, первый справа) не коснулись друг друга на AI Impact Summit в Индии в 2026 году / Скриншот Clash Report

Отдельно Красовский выделял возможности Claude в написании программного кода. Сейчас решение Claude Code является лучшим на рынке и выбирается многими разработчиками, говорит специалист. Claude Code позволяет создать рабочий программный продукт без написания кода – достаточно понимать архитектуру и принципы построения программ. Для простых задач даже этого не нужно – собственное решение можно реализовать напрямую.

При этом важно определять и собственные преимущества OpenAI ChatGPT – большие лимиты за те же деньги (если мы говорим о стандартной платной подписке в 20 долларов), более быстрая работа в обработке запросов, лучший голосовой режим. OpenAI лучше справляется с мультимодальностью – обработкой аудио и видео и созданием изображений. Также инструмент лучше работает с веб поиском и является универсальным решением, которое дает хороший результат в большинстве задач. Такой себе швейцарский нож для повседневных задач.

В Grok как преимущество Красовский выделяет меньшую цензурированность ответов, что может быть особенно важным, когда вы готовите тексты в неформальном стиле и хотите иметь "остроту" в мыслях. Кроме этого, Grok тесно связан с инфраструктурой X/Twitter, за счет чего учитывает информацию о свежих событиях и живой соцмедийный дискурс. Все, что актуально и хайпует в X/Twitter, может использоваться Grok-ом при подготовке ответов (но в то же время это сосредоточение на одной платформе).

Итак, Claude – для глубокой аналитики и кода, ChatGPT – универсальный ежедневный инструмент, Grok – для работы с актуальным соцмедийным контекстом.

Допустимо ли использование чат-ботов в военных операциях?

История с Anthropic и Пентагоном поставила вопрос – стоит ли вообще доверять еще не совершенному искусственному интеллекту столь чувствительную сферу как война? Не захочет ли языковая модель в одну ночь уничтожить целую цивилизацию?

Можно долго теоретически рассуждать о допустимости, но реальность такова, что они уже используются на практике. Однако, по моему мнению, важно корректное использование – это должно быть только как инструмент помощи человеку, а не как замена человеческого решения в критических вопросах.

Читайте также Боевые роботы на поле боя и рои дронов: эксперт развенчал мифы об искусственном интеллекте на войне

ИИ может быть полезным для таких целей, говорит Колдовский:

- анализа больших массивов текстовой информации;

- обобщения отчетов и донесений;

- перевода;

- логистического планирования;

- подготовки документации;

- технической или разведывательно-аналитической помощи на начальном уровне.

В то же время существует принципиальная грань, которую, по моему мнению, нельзя переходить: ИИ не должен самостоятельно принимать решение о применении силы, говорит эксперт.

Недопустимо передавать системе право самостоятельно определять цели, принимать решение об ударе или оценивать допустимость поражения и принимать решения без ответственного человека.

Причина проста: ошибка чат-бота в бытовой сфере дает ложный текст, а в военной может стоить человеческих жизней. Именно поэтому граница должна проходить там, где заканчивается вспомогательная аналитика и начинается решение, ценой которых могут быть человеческие жизни. Человек должен понимать основания рекомендации системы, иметь право и возможность ее отклонить, а также нести персональную ответственность за окончательное решение.

Использование ИИ в военных целях уже является реальностью и может повышать эффективность и сохранять жизни, добавляет Дмитрий Софина. В то же время ключевой предел – это сохранение человека как финального decision-maker в критических решениях, особенно по применению силы, а автономность без контроля – это неприемлемый риск.

Если говорить об оборонном применении, то более оправдано использовать не общие чат-боты, а собственные или специально адаптированные ИИ-решения под конкретные задачи, отмечает Юрий Гуменчук, руководитель оборонной компании Trident Group и соучредитель R&D Center Winstars.

К таким системам обычно выше доверие, поскольку они работают с релевантными данными, имеют контролируемый доступ и лучше отвечают требованиям безопасности. Общие модели могут быть полезными для отдельных вспомогательных задач, но для оборонного направления они имеют очевидные ограничения. Речь идет и о требованиях к безопасности и конфиденциальности, и о потребности в предсказуемости, воспроизводимости результатов и соответствия конкретной операционной среде.

ИИ может быть полезным в военных задачах, где нужно быстро обработать большой объем данных или помочь оператору. Но когда речь идет о критических действиях, автоматизация не должна заменять человеческое решение.

Обратите внимание! Использование таких технологий закономерно растет там, где нужно быстро обрабатывать большие объемы информации. Но главный риск сейчас не в передаче полномочий ИИ, а в данных: как они передаются, обрабатываются и не возникает ли утечка, говорит в комментарии 24 Каналу Алина Пшеничникова из Netpeak.

В 2024 – 2025 годах массово фиксировались случаи использования AI для клонирования голосов в мошенничестве: достаточно нескольких секунд аудио, чтобы воспроизвести голос человека, и большинство пользователей не могут отличить подделку.

Например, в 2024 году сотрудник компании в Гонконге перевел около 25 миллионов долларов после видеозвонка, где все участники – включая "руководство" – оказались ИИ-дипфейками. Также проблема в том, что такие системы могут генерировать или подтягивать некорректную или даже чувствительную информацию, отмечает Пшеничникова. Они не "знают" факты, а прогнозируют ответ – и могут ошибаться или придумывать.

Читайте также Минобороны делает ставку на ИИ в войне: первое интервью руководителя центра "A1" – что это и как будет работать

На одной из профильных конференций слышала о кейсе, когда украинская организация при использовании ИИ наткнулась на частные документы, касающиеся американских авиационных технологий,

– добавляет собеседница.

Дмитрий Красовский называет оборонное использование ИИ сложным вопросом, который уже не является теоретическим. ИИ, по его словам, используется в военных операциях прямо сейчас – от аналитических систем Palantir для обработки разведданных до систем вроде Gospel и Lavender в Израиле, и, конечно, в Украине, где ИИ-решения ежедневно применяются для анализа данных с поля боя, обработки аэроразведки и координации.

Допустимо ли это? По моему мнению – да, когда речь идет о защите своей страны и ценностей. Но важно понимать контекст: сейчас в мире идет полноценная гонка вооружений в сфере ИИ. США и Китай лидируют в разработке фронтирных моделей, но Израиль, Великобритания, Россия и другие страны активно внедряют ИИ в свои вооруженные силы. И если одна сторона решит добровольно отказаться от этих технологий – это не гарантирует, что так же поступят другие. Не учесть это будет опасно.

Искусственный интеллект могут использовать дроны / Фото Минобороны

Эксперт советует разделить два разных понятия:

- Чат-боты, то есть большие языковые модели – используют как инструмент для анализа разведданных, подготовки брифингов, перевода перехватов, планирования логистики.

- А автономные системы поражения – это совсем другая категория. Вопрос границы касается именно уровня автономии.

Красовский выделяет такие уровни автономии:

- Human-in-the-loop – ИИ рекомендует, человек принимает решение. Это аналитика, логистика, обработка данных. Наименее контроверсионный и, на мой взгляд, вполне допустимый уровень.

- Human-on-the-loop – ИИ действует, человек наблюдает и может вмешаться. Это, например, системы ПВО, где время реакции измеряется секундами. Но это уже "опасные воды".

- Human-out-of-the-loop – полная автономия ИИ, включая летальные решения. Такие решения не должны использоваться, но..

Почему именно здесь? Главная техническая проблема LLM – галлюцинации. Модель может уверенно выдавать некорректную информацию. Когда цена ошибки – человеческие жизни, это неприемлемый риск. Преимущество человека здесь не в эмоциях, а в моральной ответственности и способности учитывать этические и гуманитарные последствия, которые модель оценить не может.

Подытоживая, использование чат-ботов и ИИ для аналитической поддержки военных операций – допустимо и неизбежно. Но летальное решение должен принимать человек. Не потому, что ИИ недостаточно умен, а потому что ответственность за жизнь и смерть нельзя делегировать алгоритму.

Оправдано ли нынешнее всеобщее увлечение чат-ботами?

Продукты генеративных ИИ уже повсюду – в рекламе, соцсетях, работе сервисов поддержки пользователей. Действительно ли человечество нуждается в них во всех сферах?

К теме Пузырь на триллионы: как гиганты раздувают ИИ-рынок и почему эксперты вспомнили о кризисе 90-х

Увлечение чат-ботами в значительной степени оправдано, но может приводить и к досадным ситуациям без надлежащего человеческого контроля, говорит Колдовский. По его словам, оно оправдано потому, что современные системы действительно уже умеют делать много практически полезного:

- быстро обобщать материалы;

- работать с большими текстами и документами;

- помогать в аналитике и различных данных;

- экономить время на рутинных интеллектуальных задачах;

- создавать программный код.

Но часто преувеличиваются три вещи:

- Надежность – чат-боты могут ошибаться, выдумывать факты или давать слишком уверенные ложные ответы. И вряд ли в ближайшее время этот их недостаток может быть исправлен в принципе, ибо сама суть их работы предполагает формирование не научно доказанного точного ответа, как, например, в математике, а формирование наиболее вероятного ответа, что далеко не всегда является правильным, особенно когда ИИ модель не знает правильного ответа и начинает его придумывать, для этого даже есть специальный термин: "галлюцинации".

- Автономность – их часто подают как почти самостоятельных исполнителей, хотя на практике они лучше всего работают под контролем человека, и чем больше последовательных шагов делает ИИ-агент самостоятельно, тем больше вероятность отклонения от заданной цели.

- Универсальность – то, что модель блестяще работает в одном типе задач, не означает, что она так же хороша во всех остальных. Модель не будет вам говорить что она не специалист в каком-то вопросе или ей не хватает контекста, она может уверенно выдать ошибочное решение, которое вам может стоить чрезвычайно дорого, если вы ей будете слепо доверять.

Главная ошибка общественной дискуссии заключается в том, что эффектную демонстрацию часто путают с реальной операционной надежностью. Система может прекрасно выполнить большинство задач, но провалиться именно в том месте, где цена ошибки будет чрезвычайно высокой. И в отдельных сферах, в частности, военной подобные риски могут быть неприемлемыми.

Хайп вокруг чат-ботов частично оправдан, добавляет Дмитрий Софина – это действительно технология уровня инфраструктурного сдвига. Но в то же время рынок и медиа часто преувеличивают текущие возможности и недооценивают ограничения: качество данных, explainability, стабильность результатов. Поэтому важно смотреть на ИИ как на инструмент, а не как на магическое решение.

Интерес к чат-ботам вполне оправдан, потому что во многих рабочих задачах они реально экономят время, добавляет Юрий Гуменчук.

Лучше всего они работают, когда встроены в конкретный процесс: имеют доступ к нужным данным, документовм, внутренним системам. Именно в таком формате они дают наибольшую пользу. Но в то же время вокруг них сейчас действительно много завышенных ожиданий. Их иногда воспринимают как универсальное решение, хотя на практике это все же инструмент, и вовсе не замена экспертизе или ответственности человека.

Красовский из Netpeak говорит, что увлечение ИИ вполне оправданы.

То, что уже могут делать большие языковые модели (LLM) действительно впечатляет. Они помогают писать и анализировать код, готовить тексты, структурировать информацию, интерпретировать данные. Уже появляются компании с командой в 1-2 человека, которые за счет AI создают софтверные продукты, что раньше требовали бы целого отдела. Как человек, который ежедневно интегрирует AI в бизнес-процессы, я вижу реальную трансформацию в том, как люди работают.

Но медиа и рынок иногда действительно преувеличивают, считает специалист.

- Во-первых, существует разрыв между впечатляющими демо и реальным внедрением. Увидеть, как чат-бот красиво отвечает на запрос – это одно. Интегрировать его в бизнес-процесс, где он стабильно работает, не галлюцинирует и дает измеримый результат – это непростая задача.

- Во-вторых, LLM часто приписывают возможности, которых они не имеют – например, глубокий анализ больших массивов данных или экспертные знания в узких доменах. Модели действительно знают многое, но в некоторых направлениях поверхностно и могут ошибаться в деталях.

- В-третьих, многие компании, которые массово инвестируют в AI-подписки и инструменты, не могут четко посчитать возврат инвестиций.

Хорошей аналогией Красовский считает эру доткомов.

Интернет действительно изменил мир. Но в 2000 году большинство компаний, которые делали ставку на интернет, обанкротились – не потому, что технология была плохой, а потому, что ожидания рынка опережали реальность. С AI ситуация похожа, технология настоящая и трансформационная, но часть ожиданий – особенно по полной замене профессий "уже завтра" – это преувеличение, которое перегревает рынок. Увлечение оправдано, преувеличения - тоже реальные. И задача тех, кто работает с AI на практике, отделять одно от другого.

Сегодня чат-боты ИИ – это реальные рабочие инструменты, которые могут существенно усиливать человека в аналитике, письме, работе с данными, организации знаний, работе с программным кодом и еще во множестве других направлениях применения, отмечает Колдовский с IT СТЕП Университета. В то же время они не являются безошибочными и не способны полностью заменить человеческое мышление и ответственность.

Поэтому самая умная позиция, говорит эксперт, выглядит таким образом, что их следует воспринимать как вспомогательный инструмент, который должен работать под контролем человека, не должен самостоятельно принимать важные решения, особенно там, где речь идет о жизни человека. И ответственность также должен нести человек.