Детали

Чейз Уайтсайд рассказал, что пользовался ChatGPT, чтобы придумать "умные названия для цветов на палитре". Но в какой-то момент все пошло не по плану. Когда он в очередной раз развернул браузер с открытой страницей чат-бота, в левой колонке появилось больше разговоров, чем было изначально. Это были чужие разговоры.

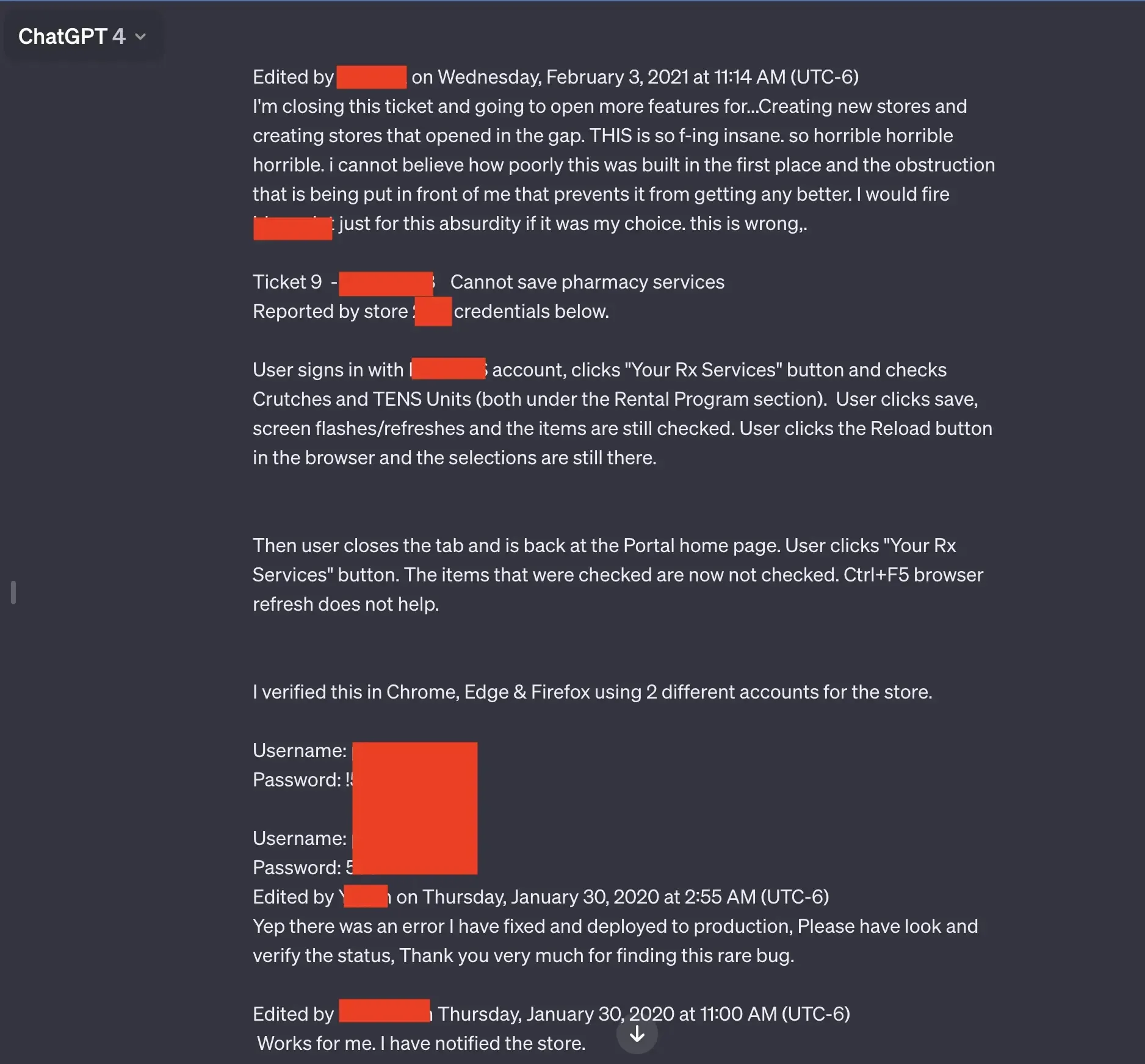

На скриншоте можно увидеть раскрытые учетные данные / Фото Ars Technica

Среди разговоров, которые читатель предоставил Ars в виде скриншотов, были презентация, детали неопубликованного исследовательского предложения и PHP-код. Один из них, похоже, содержал ленты кода для устранения неполадок на аптечном портале. Интересно, что из этого кода следует, что он был инициирован еще в 2020 и 2021 годах, то есть до того, как ChatGPT был запущен.

Сайт не объяснил несоответствие дат, но существует вероятность того, что это могло быть частью учебных данных. В прошлом году против разработчика ChatGPT, компании OpenAI, был подан массовый коллективный иск, в котором утверждалось, что компания тайно использовала огромные массивы медицинских данных и другой личной информации для обучения своих больших языковых моделей (LLMs).

Что говорит OpenAI

OpenAI уже прокомментировала эти заявления: "Ars Technica опубликовал данные еще до того, как наши команды по борьбе с мошенничеством и безопасности смогли закончить свое расследование. Их отчетность, к сожалению, неточна. Согласно нашим выводам, учетные данные пользователей были скомпрометированы, и злоумышленник воспользовался их учетной записью. История чата и отображаемые файлы — это разговоры, которые были получены в результате злоупотребления этим аккаунтом, и не было ни одного случая, чтобы ChatGPT показывал историю других пользователей".

Таким образом представители OpenAI утверждают: диалоги с ботом, о которых сообщил пользователь, являются следствием того, что его учетная запись в ChatGPT была взломана. По словам представителя OpenAI, несанкционированные входы происходили из Шри-Ланки.

Исходя из того, что было обнаружено, мы считаем это захватом учетной записи, поскольку все соответствует активности, которая наблюдается, когда кто-то вносит вклад в "пул" идентификационных данных, которые внешнее сообщество или прокси-сервер использует для распространения свободного доступа. Расследование показало, что разговоры были созданы недавно из Шри-Ланки. Эти разговоры совпадают во времени с успешными входами в систему из Шри-Ланки,

— говорит представитель компании.

Для чего кому-то было взламывать чужой аккаунт и вести там собственные разговоры с чат-ботом, неясно. Чейз Уайтсайд изменил свой пароль, но сомневается, что аккаунт был скомпрометирован. Он сказал, что использовал девятисимвольный пароль с заглавными и строчными буквами и специальными символами, и больше нигде им не пользовался.

Объяснение OpenAI, скорее всего, означает, что первоначальное подозрение в том, что ChatGPT сливает истории чатов сторонним пользователям, было ошибочным. Однако вместе с тем журналисты отмечают, что компании стоит задуматься над введением двухфакторной авторизации и отслеживания последних входов.

За свою менее чем 18-месячную историю ChatGPT неоднократно обвиняли в том, что он является "дырявой трубой, которая протекает":

- В марте 2023 года OpenAI была вынуждена признать, что из-за сбоя чат-бот показывал некоторым пользователям разговоры друг друга.

- В декабре компания выпустила патч, который исправил другую проблему, из-за которой данные пользователей могли попасть к третьим лицам.

- А в конце 2023 года исследователи Google обнаружили, что с помощью определенных "атакующих" подсказок или ключевых слов, которые заставляют чат-бота делать то, чего он не должен делать, ChatGPT может раскрыть огромные массивы своих учебных данных.

Все это напоминает нам одну из главных рекомендаций, которую дают всем пользователям чат-ботов: не вводите в диалоги с ними ничего, что вы не хотели бы, чтобы увидел посторонний.