Про це заявив професор комп'ютерної інженерії Субхаш Як з Університету Оклахоми, повідомляє DailyMail.

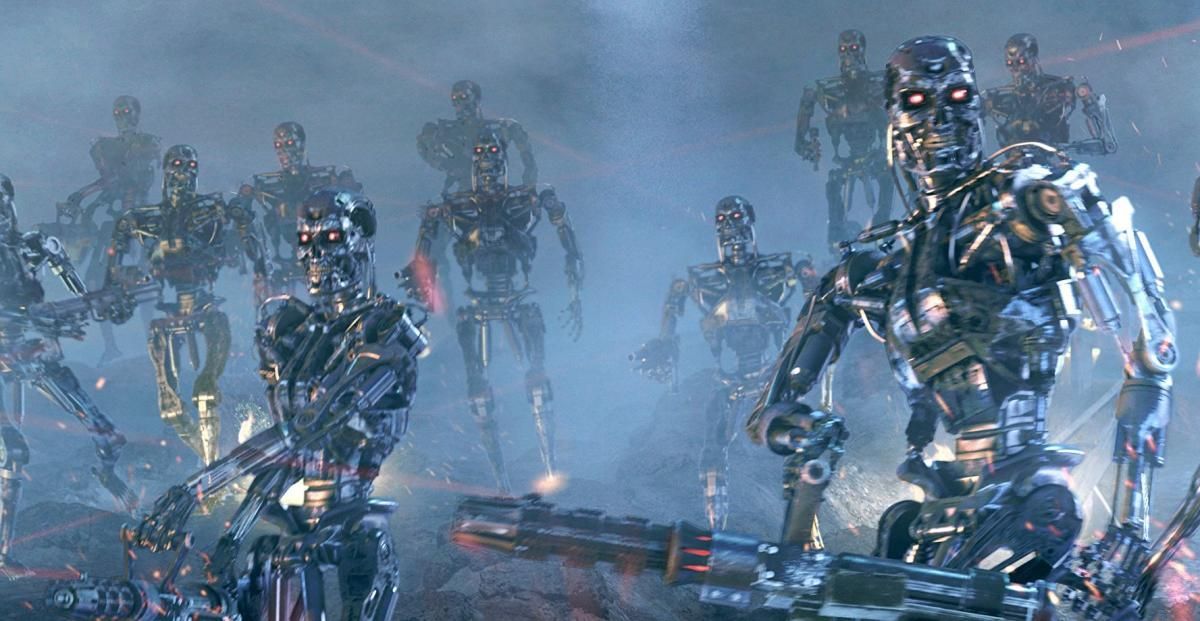

За його словами, якщо бойові роботи будуть погано закодовані, то вони можуть знайти пролом у власному програмному забезпеченні і скористатися ним для самостійного прийняття рішень. В результаті, це призведе спочатку до одиничних, а потім – і до масових вбивств людей.

Читайте також: Робот-собака від Sony вийшов на міжнародний ринок: ціна "кусається"

"Через помилку в коді у робота можуть виникнути думки, аналогічні до тих, які виникають у людей з переконаннями радикального спрямування", – припускає професор.

Також ризик професор вбачає у незавершеному та не протестованому програмному забезпеченні. Він вважає, що недоробки можуть спричинити низку внутрішніх збоїв, через які машина може "сказитися" і почати діяти, керуючись лише фрагментами коду.

Більше новин, що стосуються подій зі світу технологій, ґаджетів, штучного інтелекту, а також космосу читайте у розділі Техно