Про це повідомляє arXiv.org.

Читайте також: Робота навчили мити туалет

Вчені із Науково-дослідного інституту електроніки і телекомунікацій (ETRI) і Корейського інституту передових технологій (KAIST) вирішили навчити робота невербальній комунікації – жестам. Для цього вони зібрали датасет з 52 годин записів виступів спікерів на конференціях TED Talks.

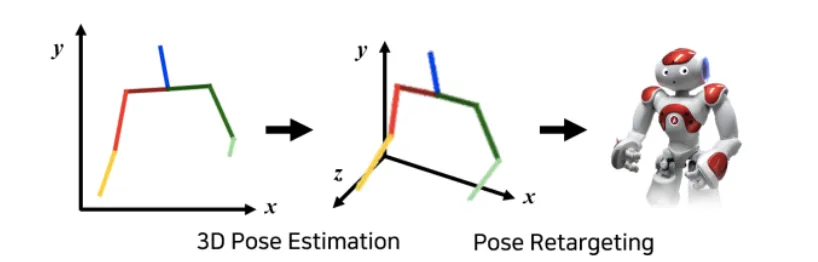

Жести людей на відео були розмічені за допомогою відкритого алгоритму OpenPose (використовувалися тільки рухи голови, торса і рук). В результаті вийшла система, яка відтворює положення тіла в тривимірному просторі відповідно до синтезованої промови.

Робот NAO навчився відворювати мовлення жестами

Потім вчені попросили 46 осіб оцінити за шкалою від 1 до 5, наскільки жести, які супроводжують мову, антропоморфні, відповідають сказаному і приємні на вигляд. Виявилося, що відтворені алгоритмом жести перевершили за всіма параметрами всі інші методи.

Читайте також: У Китаї ведучим став штучний інтелект: як він виглядає

Отриману систему використовували в гуманоїдному роботі NAO (він часто використовується в дослідженнях взаємодії роботів з людьми): автори роботи стверджують, що нейромережі вдалося успішно відтворити задані йому комбінації рухів.

Більше новин, що стосуються подій зі світу технологій, ґаджетів, штучного інтелекту, а також космосу читайте у розділі Техно